文章目录

- Hadoop核心概念

- HDFS(Hadoop Distributed File System)

- MapReduce

- 安装和配置Hadoop

- 实战代码

- HDFS的基本操作

- 文件读写

- 权限管理

- 面试题及答案

- 面试题1:Hadoop和传统的关系型数据库有什么区别?

- 面试题2:请解释MapReduce的工作原理。

- 面试题3:HDFS的设计理念是什么?

- 面试题4:如何优化MapReduce作业的性能?

- 面试题5:Hadoop支持哪些类型的数据存储格式?

- 面试题6:Hive是什么,它是如何工作的?

- 面试题7:Hive和传统数据库有什么区别?

- 面试题8:Hive中的外部表和内部表有什么区别?

- 面试题9:Hive如何优化查询性能?

- 面试题10:Hive支持哪些数据类型?

- 面试题11:解释Hive中的JOIN操作。

在当今大数据时代,处理海量数据已成为企业和组织面临的一大挑战。 Hadoop作为一个开源的分布式存储和计算框架,已经成为解决这一问题的核心技术之一。本文将深入剖析Hadoop的基本原理和应用,帮助读者理解并掌握这一强大的技术工具。

Hadoop核心概念

HDFS(Hadoop Distributed File System)

HDFS是Hadoop的分布式文件系统,它能够存储大量数据,并提供高吞吐量的数据访问。HDFS具有高度的容错性,通过数据块(默认大小为128MB)和副本机制,确保数据的可靠性和可用性。

MapReduce

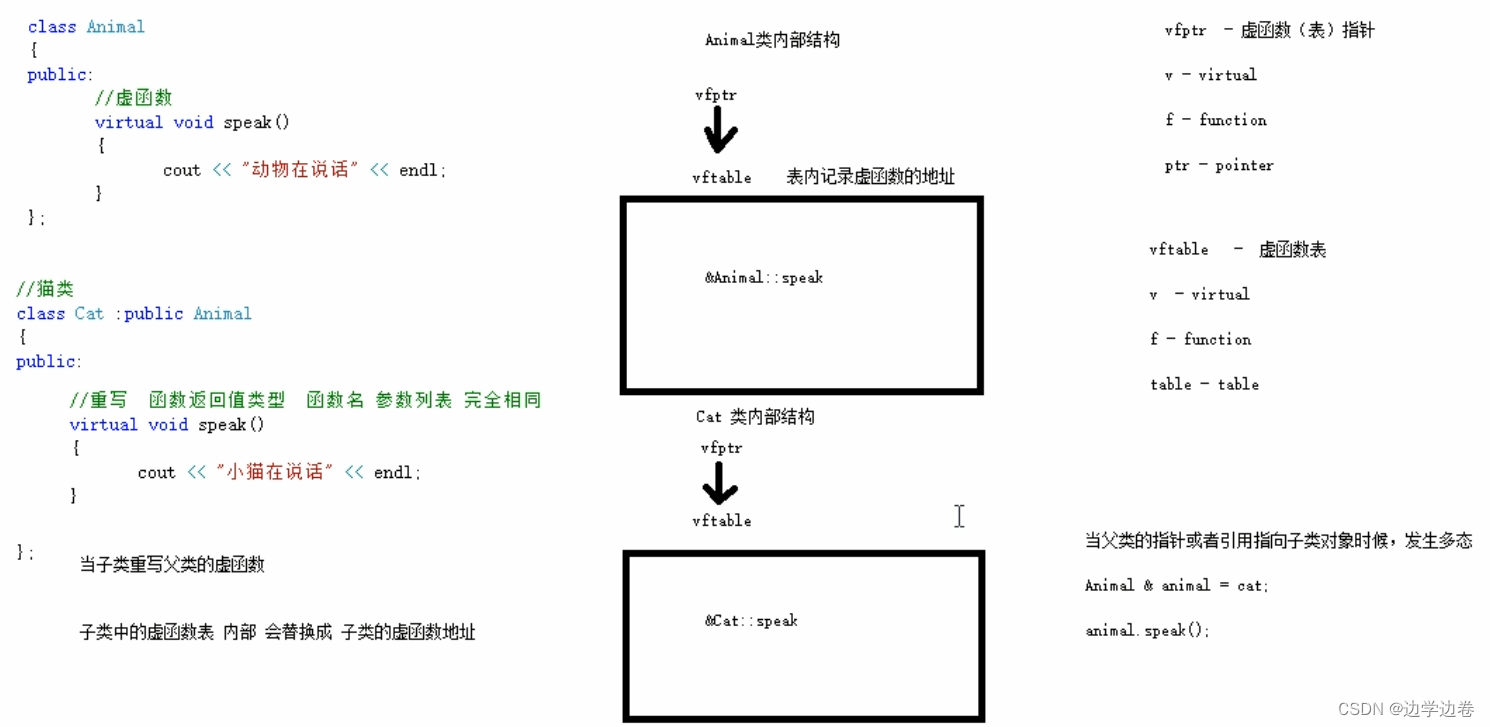

MapReduce是Hadoop的编程模型,用于处理存储在HDFS中的大数据集。它包括两个阶段:Map阶段和Reduce阶段。Map阶段处理输入数据并生成中间键值对,Reduce阶段则对这些键值对进行合并处理,得到最终结果。

安装和配置Hadoop

Hadoop的安装和配置是开始使用Hadoop的第一步。以下是安装Hadoop的基本步骤:

- 确保Java环境已正确安装。

- 下载Hadoop二进制文件,并解压到指定目录。

- 配置环境变量,包括HADOOP_HOME和PATH。

- 配置Hadoop的核心配置文件,如

core-site.xml、hdfs-site.xml和mapred-site.xml。 - 格式化HDFS文件系统,启动Hadoop集群。

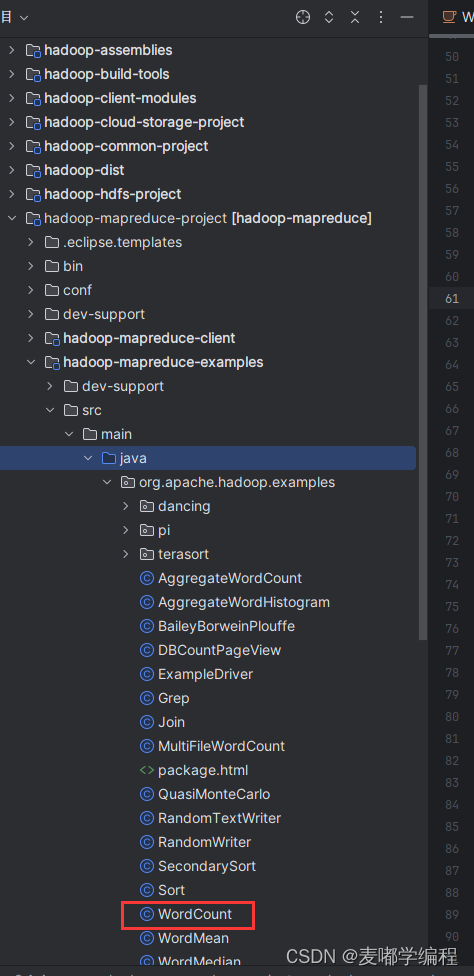

实战代码

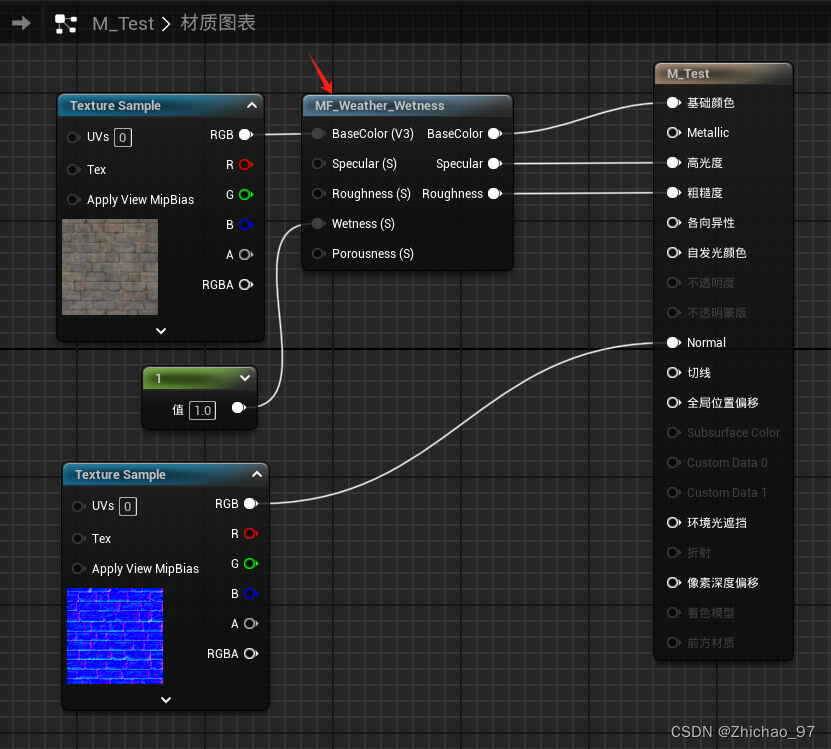

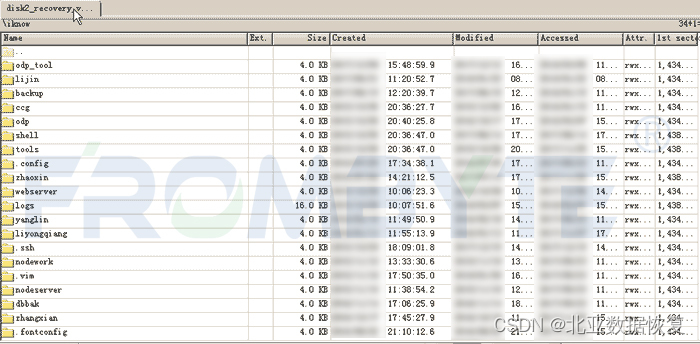

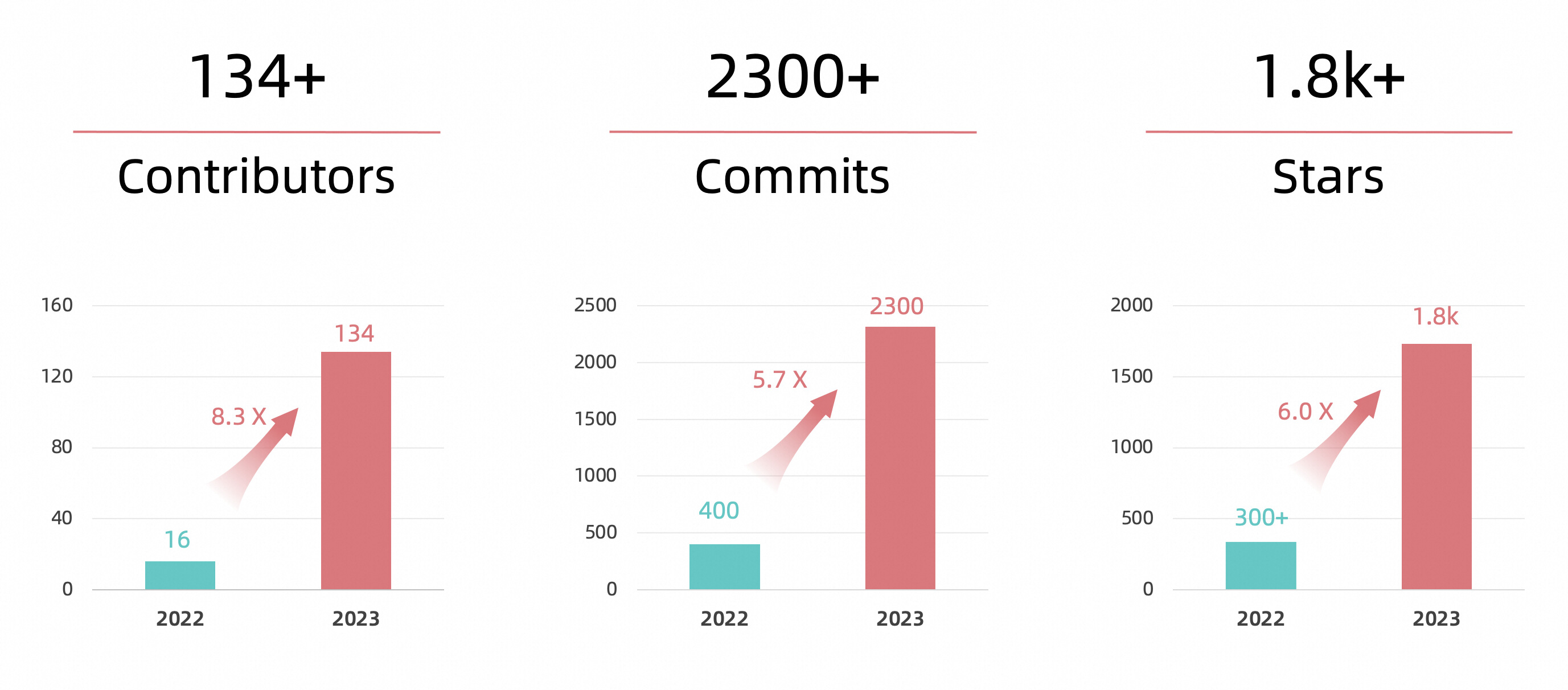

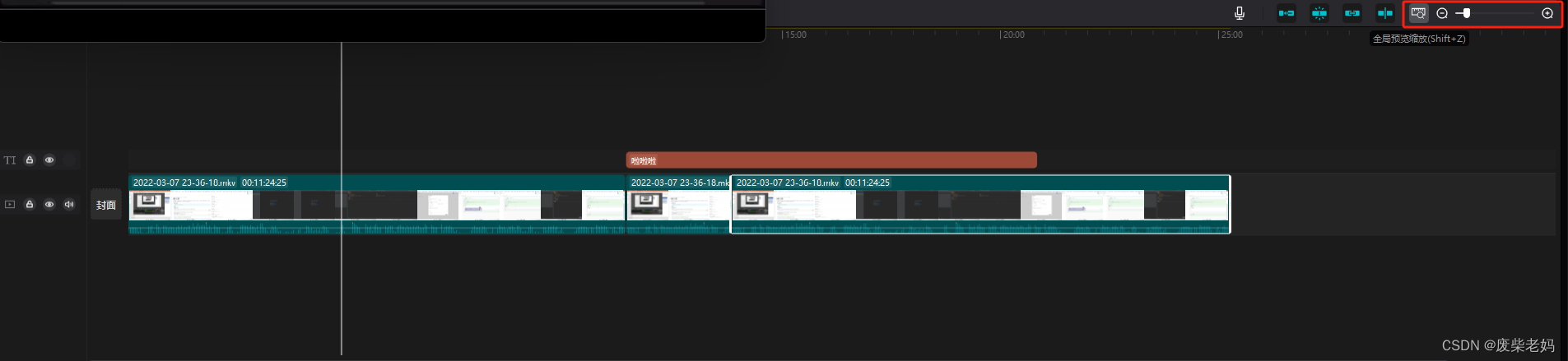

hadoop代码github

HDFS的基本操作

文件读写

HDFS提供了一套命令行接口,用于文件的读写操作。常用的文件操作命令包括:

hadoop fs -mkdir:创建目录hadoop fs -put:上传文件到HDFShadoop fs -cat:读取文件内容hadoop fs -get:从HDFS下载文件hadoop fs -rm:删除文件

权限管理

HDFS支持基于Unix文件系统的权限管理,包括用户、组和权限设置。通过以下命令可以进行权限管理:

hadoop fs -chown:更改文件或目录的所有者hadoop fs -chmod:更改文件或目录的权限hadoop fs -chgrp:更改文件或目录的所属组

面试题及答案

在面试过程中,对Hadoop的深入理解往往能够给面试官留下深刻印象。以下是一些常见的Hadoop面试题及答案,帮助您在面试中表现出色。

面试题1:Hadoop和传统的关系型数据库有什么区别?

答案:

Hadoop与传统的关系型数据库(RDBMS)在多个方面存在显著差异:

- 数据类型:RDBMS通常处理结构化数据,而Hadoop处理结构化、半结构化和非结构化数据。

- 查询性能:RDBMS针对快速查询和事务处理进行了优化,而Hadoop适合批量处理大数据。

- 扩展性:Hadoop通过在廉价硬件上运行分布式计算来实现水平扩展,而RDBMS通常依赖于昂贵的硬件来提升性能。

- 容错性:Hadoop通过数据副本和分布式计算框架提供高容错性,RDBMS则依赖于事务日志和备份机制。

面试题2:请解释MapReduce的工作原理。

MapReduce的工作原理分为两个主要阶段:

- Map阶段:输入数据被切分为多个数据块,每个数据块由一个Map任务处理。Map任务读取数据块,将其转换为键值对,并输出。

- Reduce阶段:Map阶段输出的键值对被排序和合并,然后传递给Reduce任务。Reduce任务根据键对数据进行汇总,生成最终的输出。

面试题3:HDFS的设计理念是什么?

HDFS的设计理念包括以下几点:

- 高可靠性:通过数据副本机制,即使部分节点失败,数据也不会丢失。

- 高吞吐量:优化数据访问模式,适合大规模数据集的批量处理。

- 简单性:提供简单的接口,便于应用程序开发。

- 可扩展性:设计成可以轻松扩展至数千个节点。

面试题4:如何优化MapReduce作业的性能?

优化MapReduce作业性能的方法包括:

- 合理分区:确保数据均匀分配到各个Reduce任务,避免数据倾斜。

- 使用Combiner:在Map阶段进行局部聚合,减少网络传输量。

- 优化序列化:使用高效的序列化机制,减少数据的I/O开销。

- 配置合理的内存和CPU资源:为MapReduce作业配置适当的内存和CPU资源,避免资源争用。

面试题5:Hadoop支持哪些类型的数据存储格式?

Hadoop支持多种数据存储格式,包括:

- 文本文件:简单的存储格式,易于使用,但不是高效的存储格式。

- SequenceFile:Hadoop提供的二进制格式,支持压缩。

- Avro:提供丰富的数据结构和压缩选项。

- Parquet:列式存储格式,适合分析型查询。

- ORC:优化的行式列式存储格式,提供高效的压缩和编码。

面试题6:Hive是什么,它是如何工作的?

Hive是一个建立在Hadoop生态系统之上的数据仓库软件,它提供了一种SQL-like的查询语言,称为HiveQL,用于查询和分析存储在Hadoop分布式文件系统(HDFS)中的大数据集。Hive将HiveQL语句转换为MapReduce、Tez或Spark作业,然后在Hadoop集群上执行,从而使得用户能够以类似于传统关系型数据库的方式进行大数据操作。

面试题7:Hive和传统数据库有什么区别?

Hive与传统数据库的主要区别在于:

- 处理数据量:Hive设计用于处理大规模数据集,而传统数据库更适合处理小到中等规模的数据。

- 查询性能:传统数据库优化了实时查询和事务处理,而Hive更擅长批量处理大数据。

- 存储:Hive存储数据在HDFS或兼容的文件系统中,而传统数据库使用自己的存储引擎。

- 扩展性:Hive通过增加更多的节点来实现水平扩展,而传统数据库可能需要更复杂的分片或集群解决方案。

面试题8:Hive中的外部表和内部表有什么区别?

在Hive中,表可以分为内部表和外部表:

- 内部表:由Hive完全管理,当删除内部表时,其数据也会被删除。

- 外部表:Hive只管理表的元数据,数据的存储并不受Hive的控制。删除外部表不会影响底层数据。

面试题9:Hive如何优化查询性能?

Hive查询性能可以通过以下方式优化:

- 索引:使用索引可以加快查询速度,尤其是在大型数据集上。

- 分区:通过将数据分区,可以减少查询时需要扫描的数据量。

- 桶:将数据分布到桶中可以进一步优化JOIN操作和数据局部性。

- 向量化查询:使用向量化执行引擎可以提高查询处理速度。

- 资源管理:合理配置YARN资源池,确保Hive作业有足够的资源执行。

面试题10:Hive支持哪些数据类型?

Hive支持多种数据类型,包括:

- 基本类型:如INT、STRING、BOOLEAN、FLOAT、DOUBLE等。

- 复杂类型:如ARRAY、MAP、STRUCT等。

- 时间类型:如TIMESTAMP等。

- 集合类型:Hive还支持集合类型,如列表(LIST)和映射(MAP)。

面试题11:解释Hive中的JOIN操作。

Hive中的JOIN操作用于将两个或多个表中的数据根据某些共同的字段合并在一起。Hive支持多种类型的JOIN:

- INNER JOIN:只返回两个表中匹配的记录。

- LEFT OUTER JOIN:返回左表的所有记录,以及右表中匹配的记录。如果右表中没有匹配,则结果为NULL。

- RIGHT OUTER JOIN:与LEFT OUTER JOIN相反,返回右表的所有记录,以及左表中匹配的记录。

- FULL OUTER JOIN:返回两个表中所有的记录。如果某一边没有匹配,则相应位置为NULL。